Fallgeschichte: Jugendbeschäftigungsprogramm neu gedacht

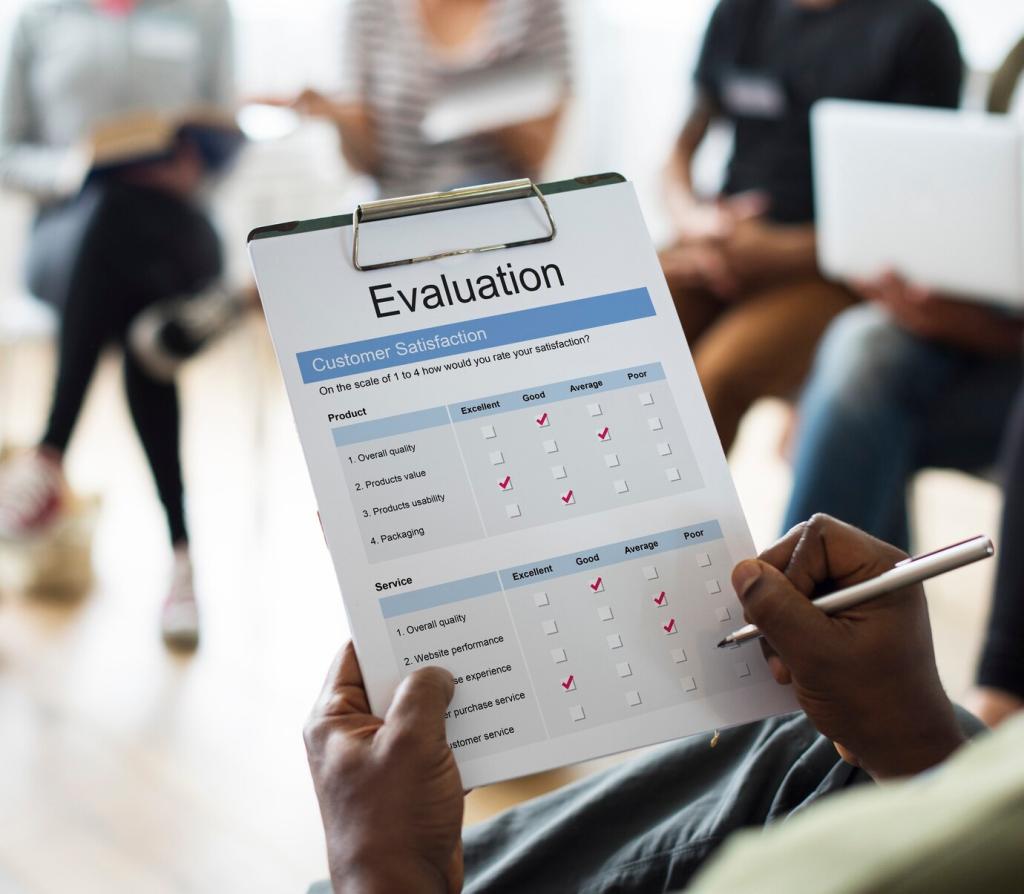

Ein städtisches Programm meldete gute Teilnahme, aber schwache Verbleibsquoten: Nach vier Monaten hatten nur wenige eine feste Stelle, die Abbrüche lagen deutlich höher als geplant. Dashboards zeigten Muster, aber keine Gründe. Die Leitung verlangte: „Belege und Erklärungen, bitte, nicht nur Eindrücke.“

Fallgeschichte: Jugendbeschäftigungsprogramm neu gedacht

In Fokusgruppen berichteten Teilnehmende von Schichtarbeit, langen Wegen und fehlender Kinderbetreuung. Aylin, alleinerziehend, erzählte, wie Kurszeiten mit der Betreuung kollidierten. Ein Coach notierte leise: „Wir zielen auf Motivation, scheitern aber an Logistik.“ Plötzlich bekamen die Zahlen eine nachvollziehbare Geschichte.